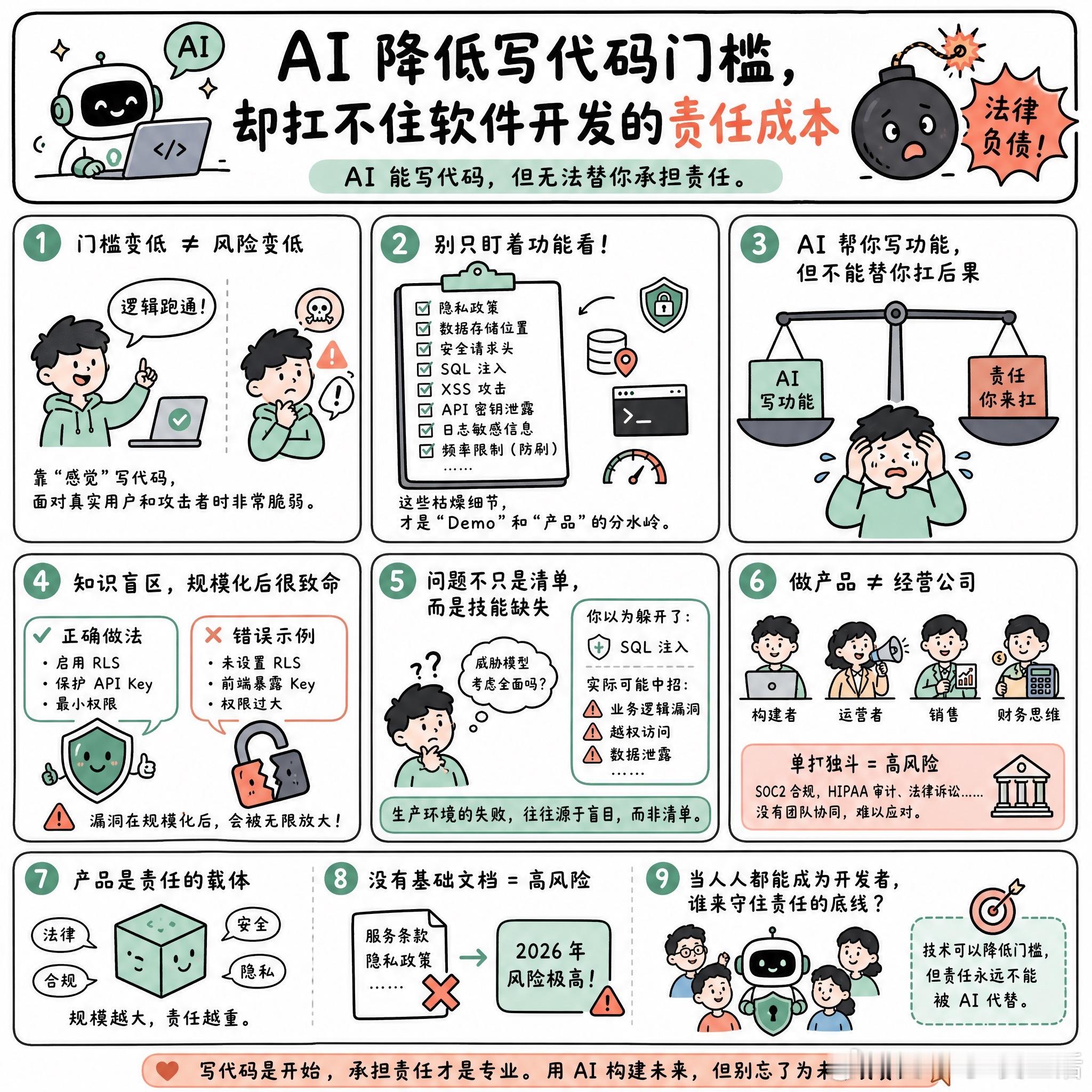

【AI降低写代码门槛,却扛不住软件开发的责任成本】

快速阅读:AI 极大地降低了写代码的门槛,却没能降低对软件负责的成本。如果只靠“感觉”写代码(Vibe Coding)而忽略了安全、隐私和合规,你交付的不是产品,而是一个随时会爆炸的法律负债。

现在的开发门槛变低了,低到很多人觉得只要 AI 能跑通逻辑,产品就算成了。这种靠“感觉”驱动的开发模式,在面对真实用户和攻击者时非常脆弱。

AI 可以帮你写出功能,但它无法替你承担责任。

一个拥有 20 年经验的工程师列出了一份清单,提醒那些想靠 AI 快速上线的人:别只盯着功能看。隐私政策、数据存储位置、安全请求头、SQL 注入、XSS 攻击、API 密钥是否泄露在前端、日志里有没有敏感信息,还有防止 API 账单被刷爆的频率限制。这些看似枯燥的工程细节,才是区分“写个 Demo”和“做一个产品”的分水岭。

有网友提到,AI 降低了构建软件的成本,但并没有降低运行软件的复杂性。如果你在没有设置 RLS(行级安全性)的情况下直接用 Supabase,或者在前端暴露了 API Key,这种由于知识盲区导致的漏洞,在规模化之后会非常致命。

更有意思的观点是,这种现象其实是“技能缺失”而非单纯的“开发模式问题”。有些开发者认为可以让 AI 直接生成这些安全检查,但现实是,生产环境的失败往往源于盲目的威胁模型,而不是漏掉了一个清单。你躲开了 SQL 注入,可能却在业务逻辑上留下了漏洞。

这也引出了一个更深层的差异:做一个产品和经营一家公司是两回事。

一个资深工程师指出,很多创始人试图一个人扛下所有,但伟大的业务需要构建者、运营者、销售和财务思维的协同。单纯靠热情和 AI 堆砌出的代码,在面对 SOC2 合规、HIPAA 审计或者复杂的法律诉讼时,往往不堪一击。

当产品规模增长到一定程度,它就不再只是代码的集合,而是一个需要处理法律、安全和合规的实体。

如果一个应用连服务条款都没有,它在 2026 年面临的风险可能会非常高。现在的问题是,当 AI 让每个人都能成为开发者时,谁来确保这些开发者知道自己正在面对什么样的风险?

x.com/PrajwalTomar_/status/2055294397475148123