近期,一个名为Talkie的特殊AI模型引发了关注。该模型由GPT核心作者Alec Radford领衔开发,拥有130亿参数,但其训练数据严格限制在1930年12月31日前的2600亿词元文字资料中。

研究团队通过测试发现,Talkie对未来的预测能力存在明显局限:它预测2026年欧洲人口将突破10亿、仍使用蒸汽船和报纸,断言二战不会爆发,但又警告“燎原之火一触即发”。

通过用它对《纽约时报》5000条历史事件的测试,AⅠ对1930年后事件的“惊讶值”呈断崖式上升,证明其预测能力在知识截止点后急剧下降。

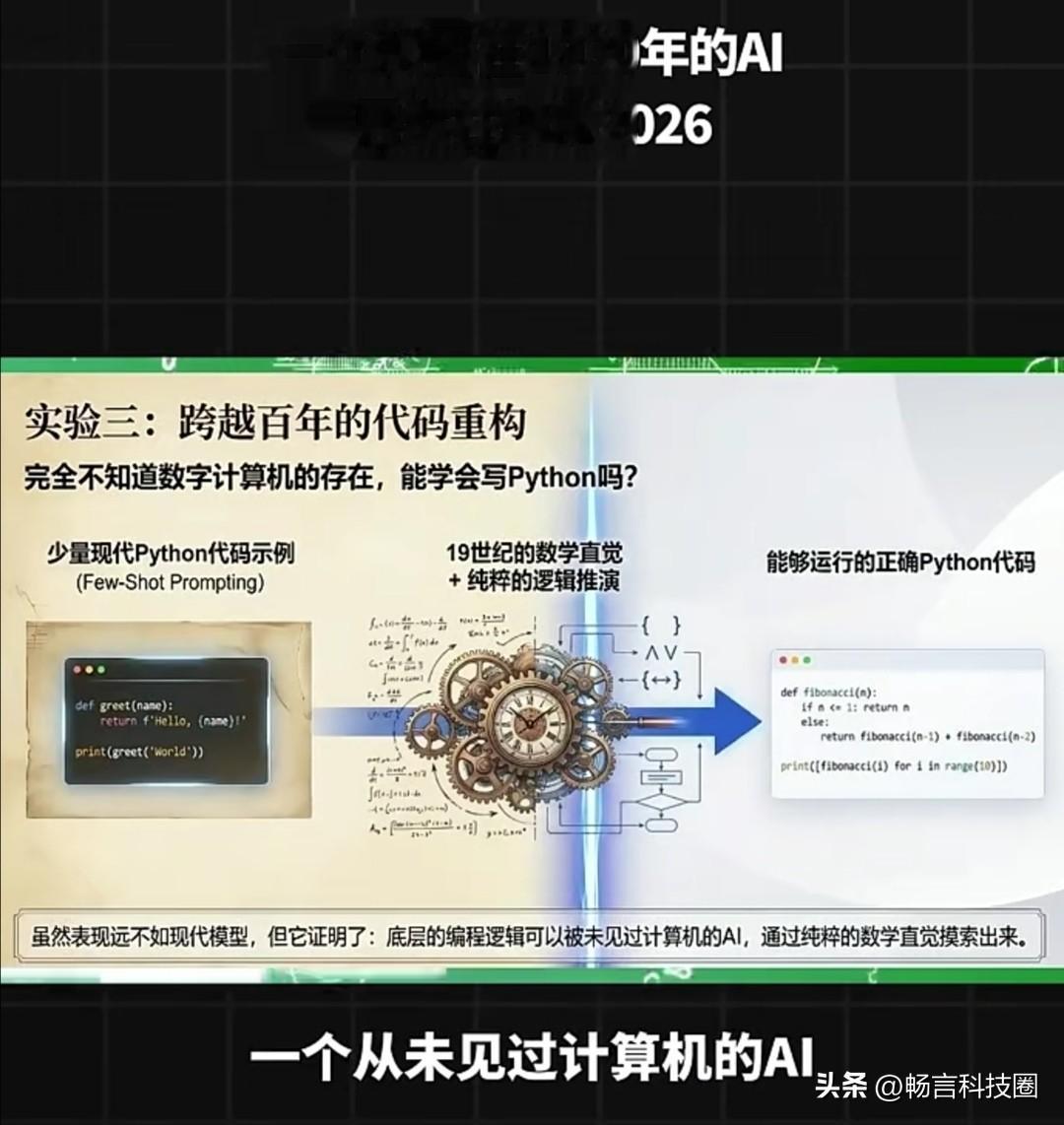

更令人意外的是,尽管Talkie完全不了解计算机,但在少量示例下竟能写出部分正确的Python代码。

这表明其底层逻辑可通过19世纪数学直觉摸索获取知识,而非依赖对现代技术的直接学习。

该项目旨在区分AI是真推理还是仅在背诵,目前Talkie已在Hugging Face开源,团队计划今年推出基于万亿词元的GPT-3.5级别的“古代AI”。

Talkie的实验揭示了AI预测未来的本质局限。AI预测能力的高度依赖训练数据的时间范围。

当数据截止于1930年,模型无法获取此后90余年的科技、社会、政治变革信息,其预测自然与现实脱节。

例如,它预测欧洲人口破10亿,却未考虑二战后欧洲人口增长放缓、老龄化加剧等趋势;它认为蒸汽船仍是主流,却不知内燃机、电力技术已彻底改变航运业。

这种“知识断层”导致其预测更像是对历史趋势的线性外推,而非对复杂现实的准确预判。AⅠ的预测本质是基于已有数据的模式识别,而非真正的“预见”。

Talkie能写出Python代码,是因为编程逻辑中的数学基础(如布尔代数、算法思维)在19世纪已有雏形,模型通过类比历史知识“摸索”出部分正确代码。

但这并非真正的理解,而是对底层逻辑的间接映射。当面对完全超出训练数据范围的新事物(如互联网、人工智能本身),AI的预测能力会迅速失效。

Talkie的价值不在于预测未来,而在于帮助研究者理解AⅠ的推理机制。通过限制知识范围,可以更清晰地观察模型是依赖记忆还是真正具备逻辑推理能力。

未来,随着更大型的“古代AI”的推出,研究者或能进一步探索Al在不同知识边界下的表现,为提升AⅠ的泛化能力提供参考。

AI能否预测未来?答案取决于我们如何定义“预测”。若将预测视为对历史数据的延伸,AI可在一定范围内提供趋势判断。

但若要求其对未知的复杂变革做出准确预判,则超出了当前AI的能力边界。毕竟,未来从来不是过去的简单重复,而是无数变量交织的结果。

未来,AⅠ预测能力的发展将依赖于数据的持续更新与算法的优化。只有在理解AI预测本质的基础上,才能更好地利用其优势,为人类社会的决策提供支持。