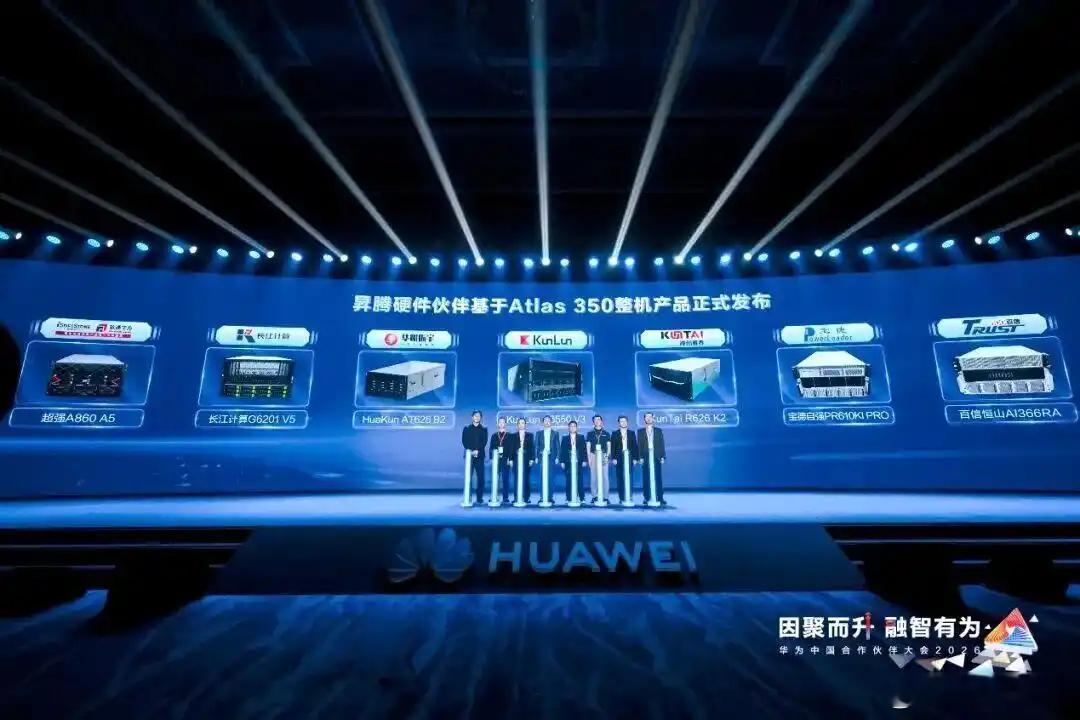

AI 国产算力芯片再传好消息!近日,华为发布了全新的 Atlas 350,搭载昇腾 950PR 芯片,定位为大模型推理旗舰卡,主打 Prefill 阶段与推荐业务场景,与英伟达 H100比有什么优劣势?H100 作为 Hopper 架构旗舰,是全球 AI 训练与推理的标杆产品,两者在定位、架构与生态上存在显著差异,以下从核心参数、优劣势与适用场景进行一下分析,大家可以有更深入的了解:

华为 Atlas 350 优势

●低精度推理性能突出:FP4 算力专为大模型 Prefill 阶段设计,在该场景下性能可达 H100 的 1.8 倍,多模态生成速度提升 60%

●内存访问优化:内存访问颗粒度从 512 字节优化至 128 字节,小算子访存效率提升 4 倍,特别适配推荐系统等高并发场景

●国产自主可控:无出口限制,适配国内 AI 生态(盘古大模型、MindSpore 框架),供应链安全有保障

●超节点扩展能力:2TB/s 互联带宽支持最大 192 颗芯片全互连,满足 MoE 模型专家并行需求

●价格优势:成本约为 H100 的 60%-70%,适合大规模部署

英伟达 H100 优势

●生态垄断地位:CUDA 生态 + TensorRT 优化,适配全球 90%+AI 框架与应用,开发工具链成熟

●全场景覆盖:从千亿参数模型训练到边缘推理,产品线完整,无需更换硬件平台

●通用计算能力:FP8/FP16/FP32 全精度性能均衡,尤其在训练场景下领先 Atlas 350 约 40%

●软件工具链:调试、优化工具丰富,支持多实例 GPU(MIG)等高级特性,开发效率高

●全球兼容性:适配国际主流云服务平台与企业级软件,无迁移成本

各自短板

华为 Atlas 350:生态成熟度不足,适配非国产框架需额外开发;训练能力弱于 H100,不适合大规模模型训练;功耗效率在通用场景下低于 H100

英伟达 H100:受美国出口管制,国内企业采购受限;价格昂贵(约 25 万元 / 卡);FP4 精度支持不足,在 Prefill 等特定推理场景性能不如 Atlas 350

适用场景:

优先选择 Atlas 350 的场景●国内大模型推理(特别是 Prefill 阶段),如文心一言、通义千问等国产模型部署●互联网推荐业务(如电商、短视频推荐系统),小算子密集型计算需求高●追求国产可控与供应链安全,避免外部制裁风险的企业●超大规模集群部署,需要高互联带宽与内存容量的场景

优先选择 H100 的场景●全球部署的 AI 应用,需要兼容国际生态与框架●大规模模型训练(如 GPT-4 级千亿参数模型),对 FP8/FP16 算力要求高科研机构与高校,需要丰富的开发工具与全球技术支持●边缘计算与嵌入式场景,需要 MIG 等灵活部署特性