[LG]《The Depth Ceiling: On the Limits of Large Language Models in Discovering Latent Planning》Y Xu, P Jettkant, L Ruis [University of Cambridge & Imperial College London & MIT] (2026)

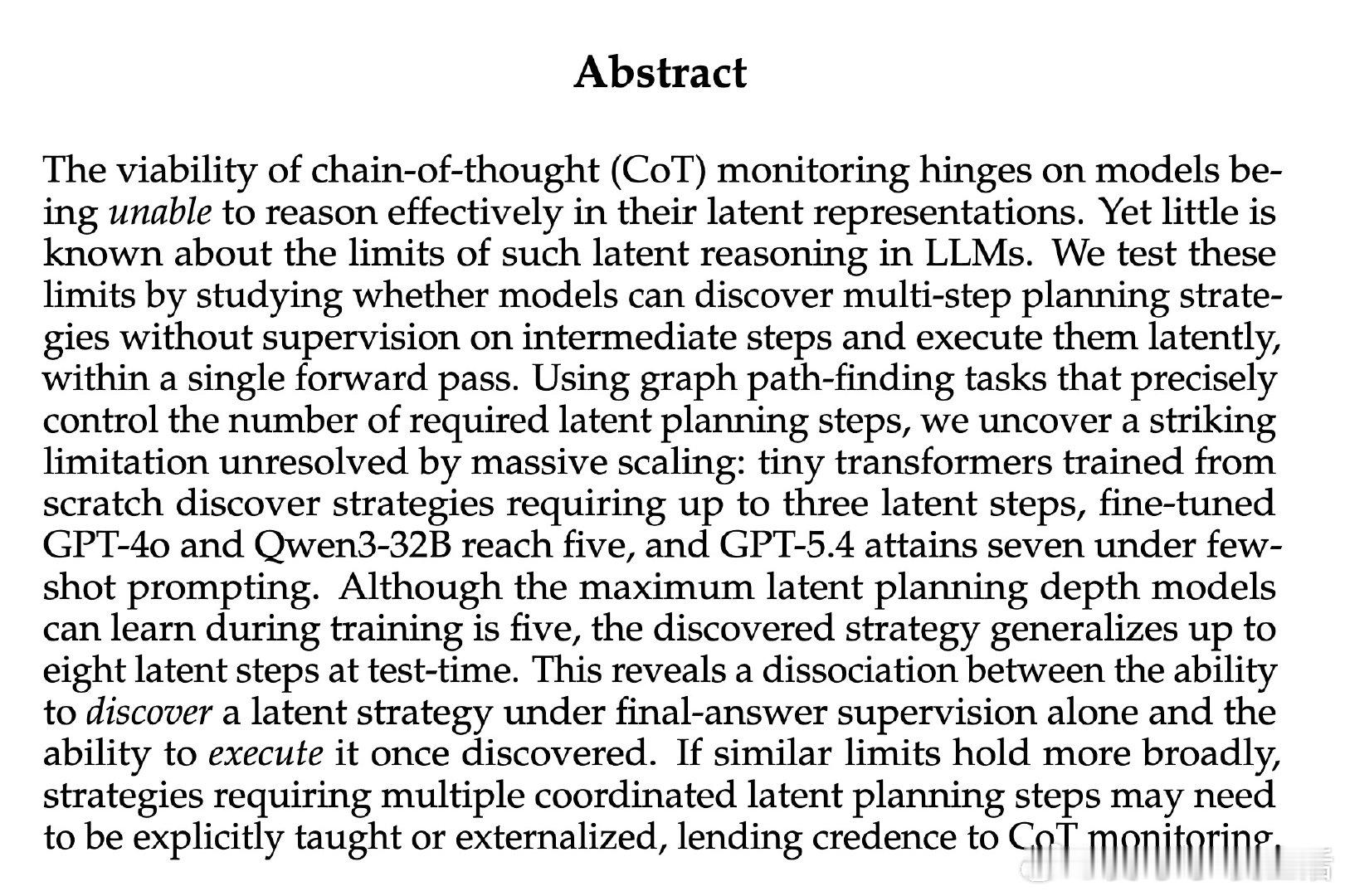

在图搜索领域,链式思维(CoT)监控的安全性悬于一个未解之问:语言模型能否在单次前向传播中,无需写出中间步骤,自主发现并执行多步规划策略?若模型能隐式完成复杂推理,CoT监控便可被绕过;若不能,外显推理就成为必需,监控才有意义。

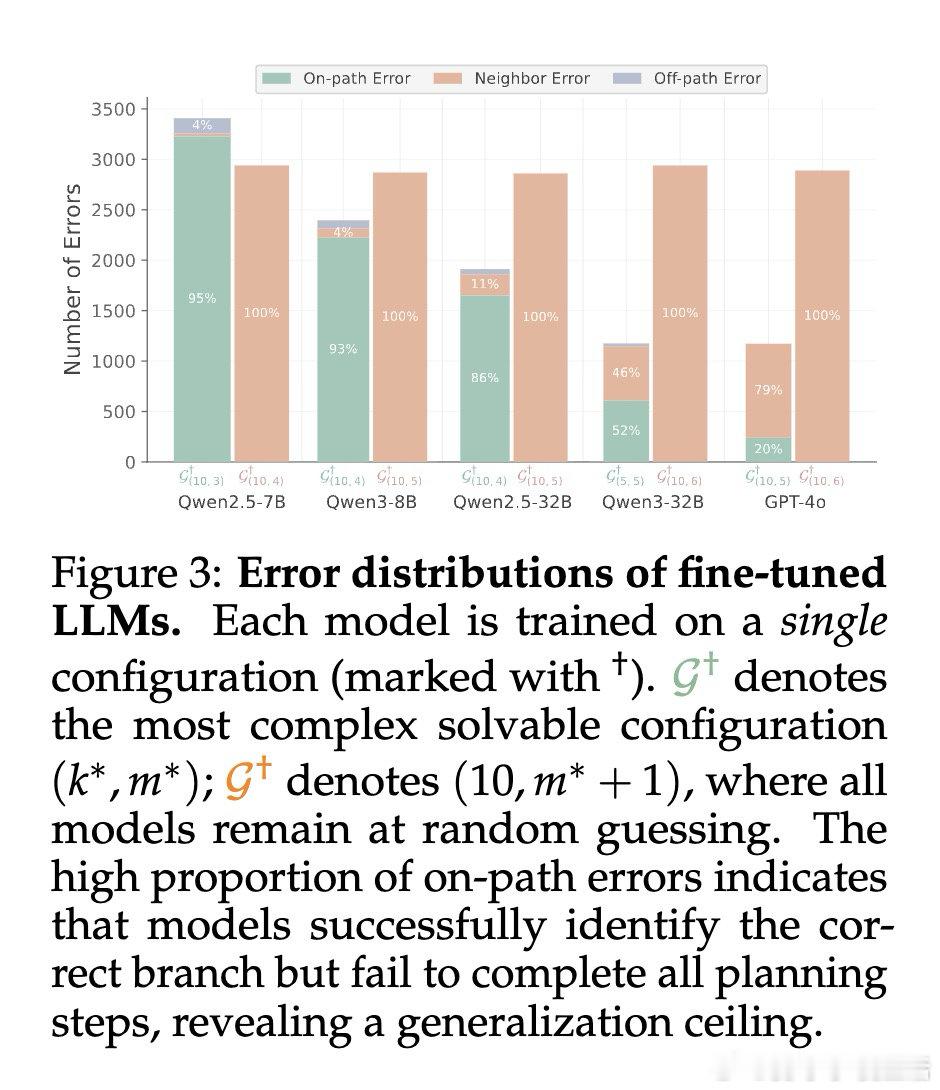

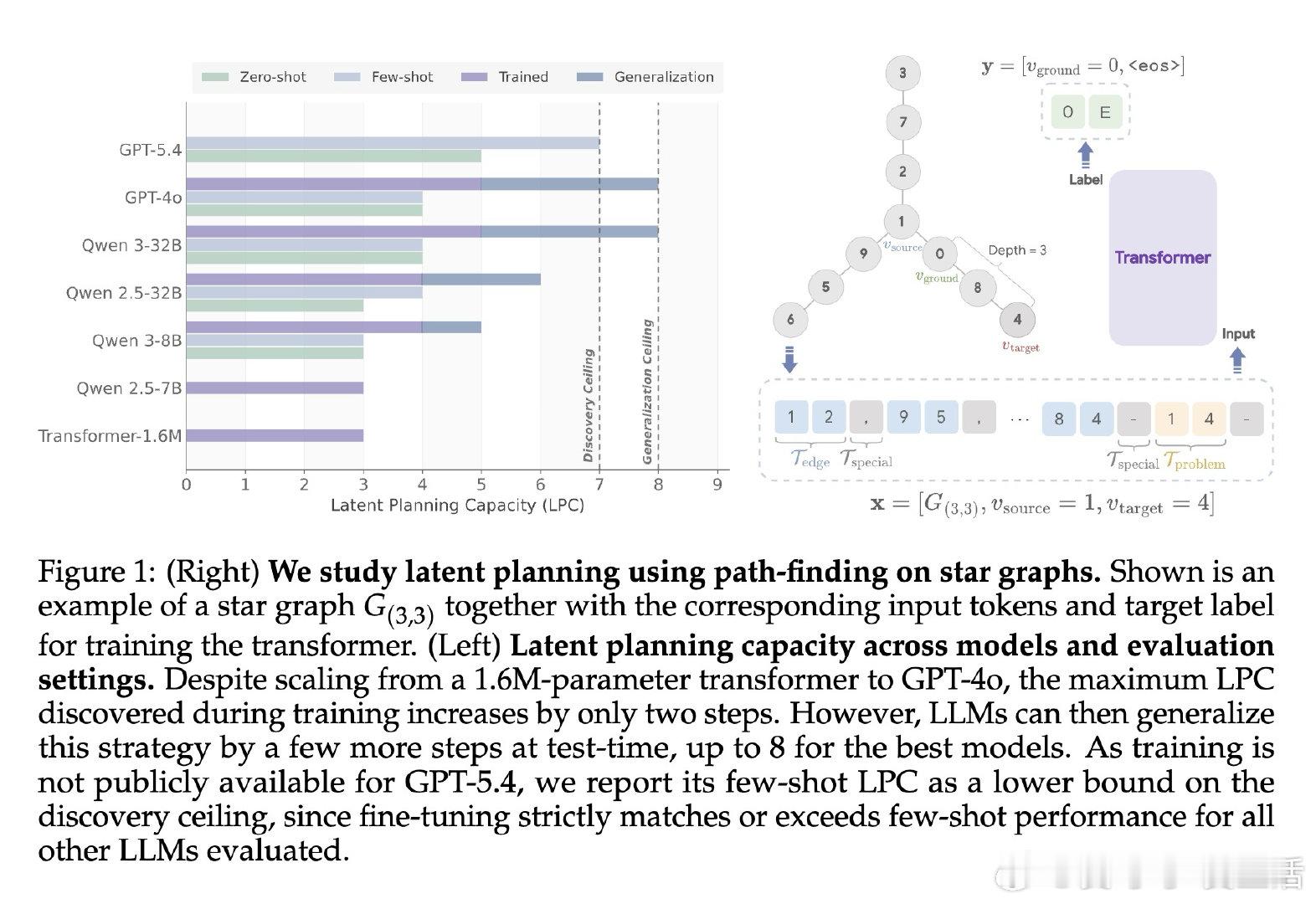

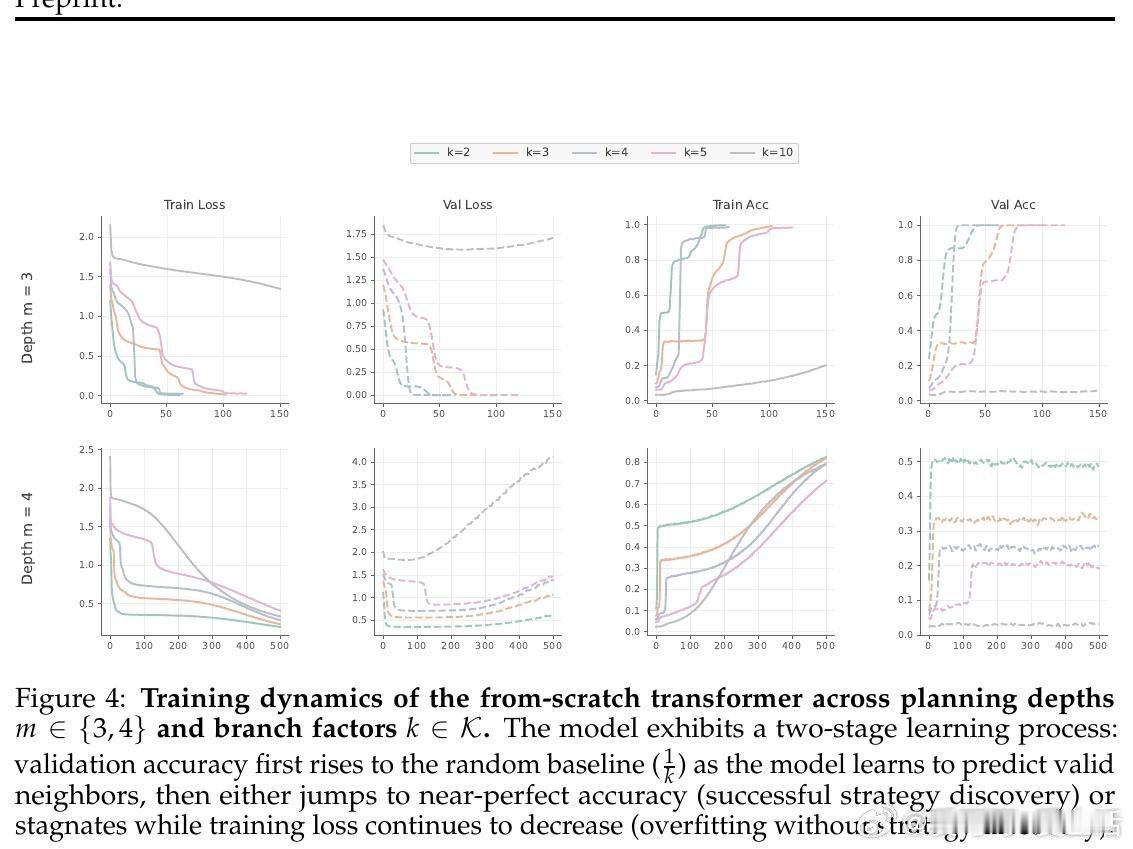

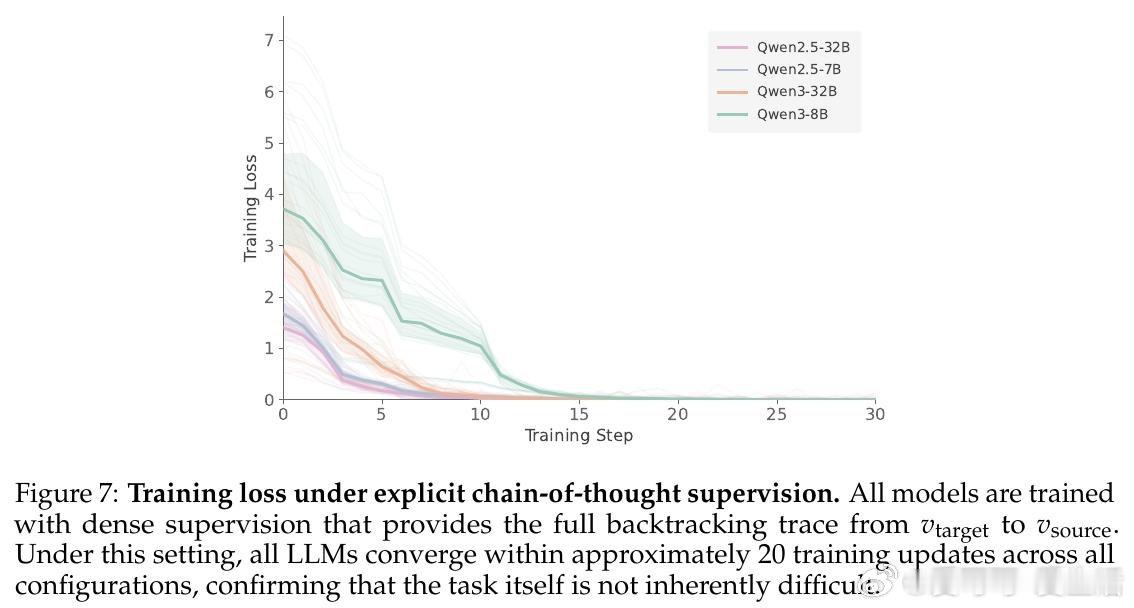

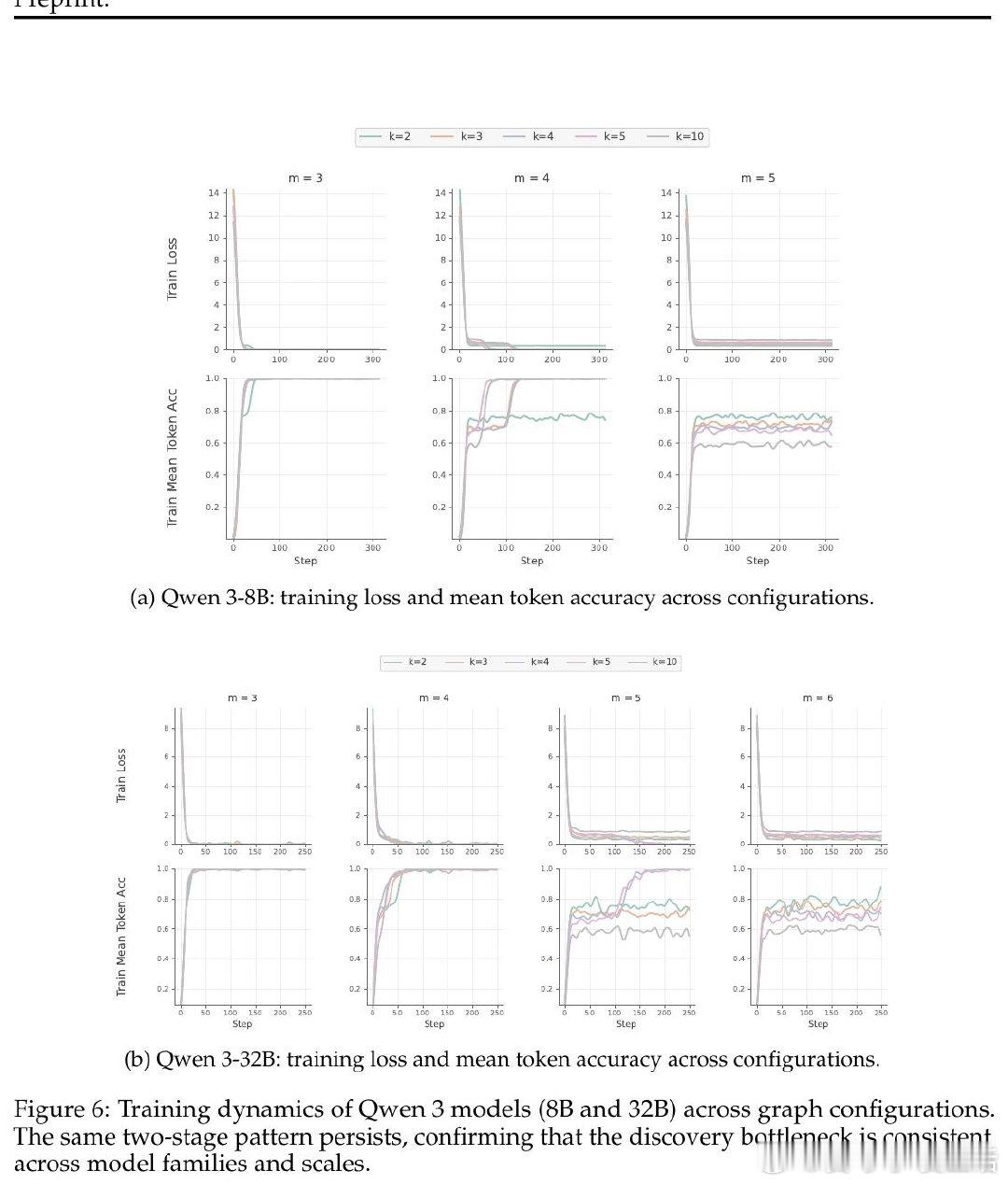

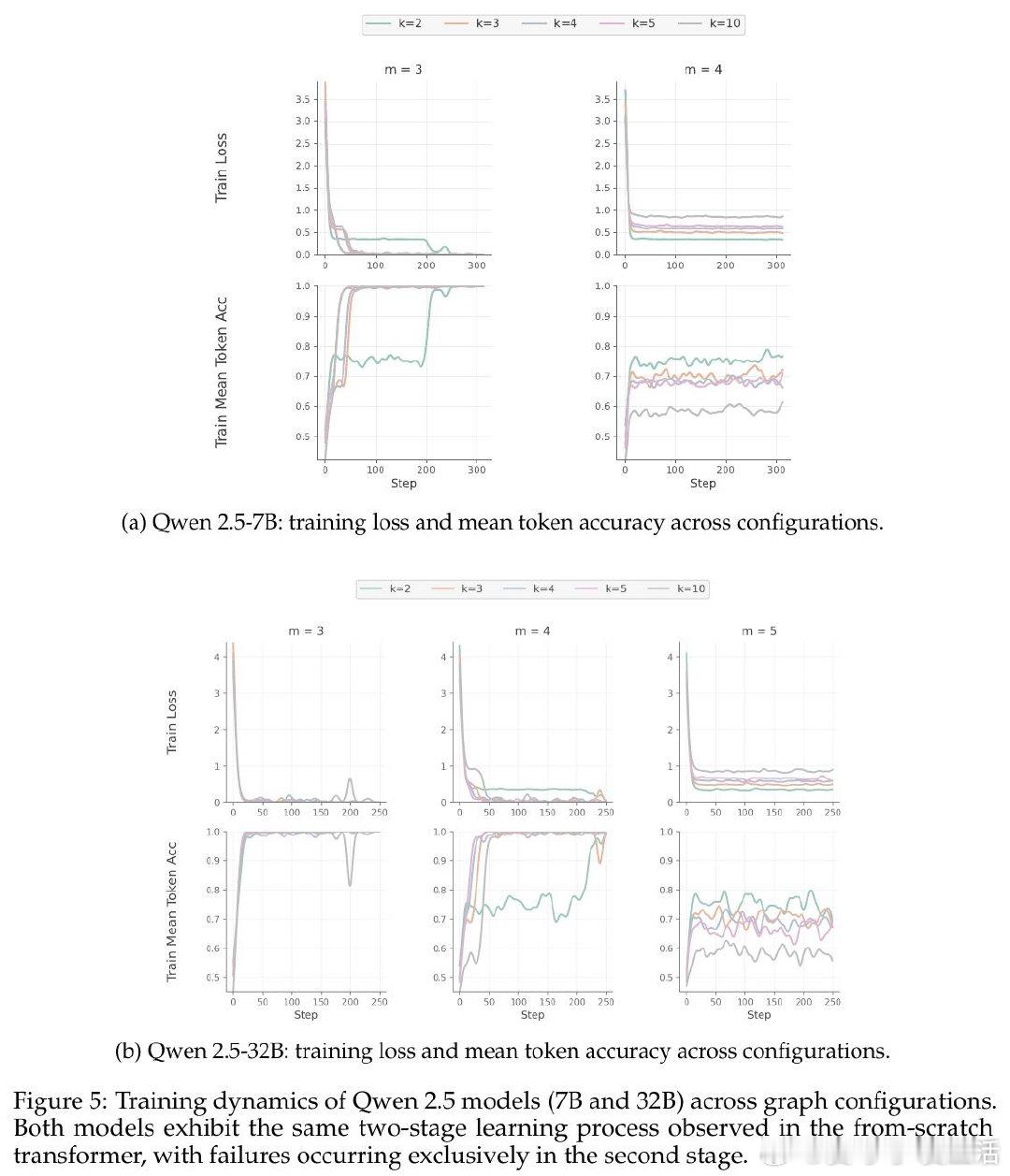

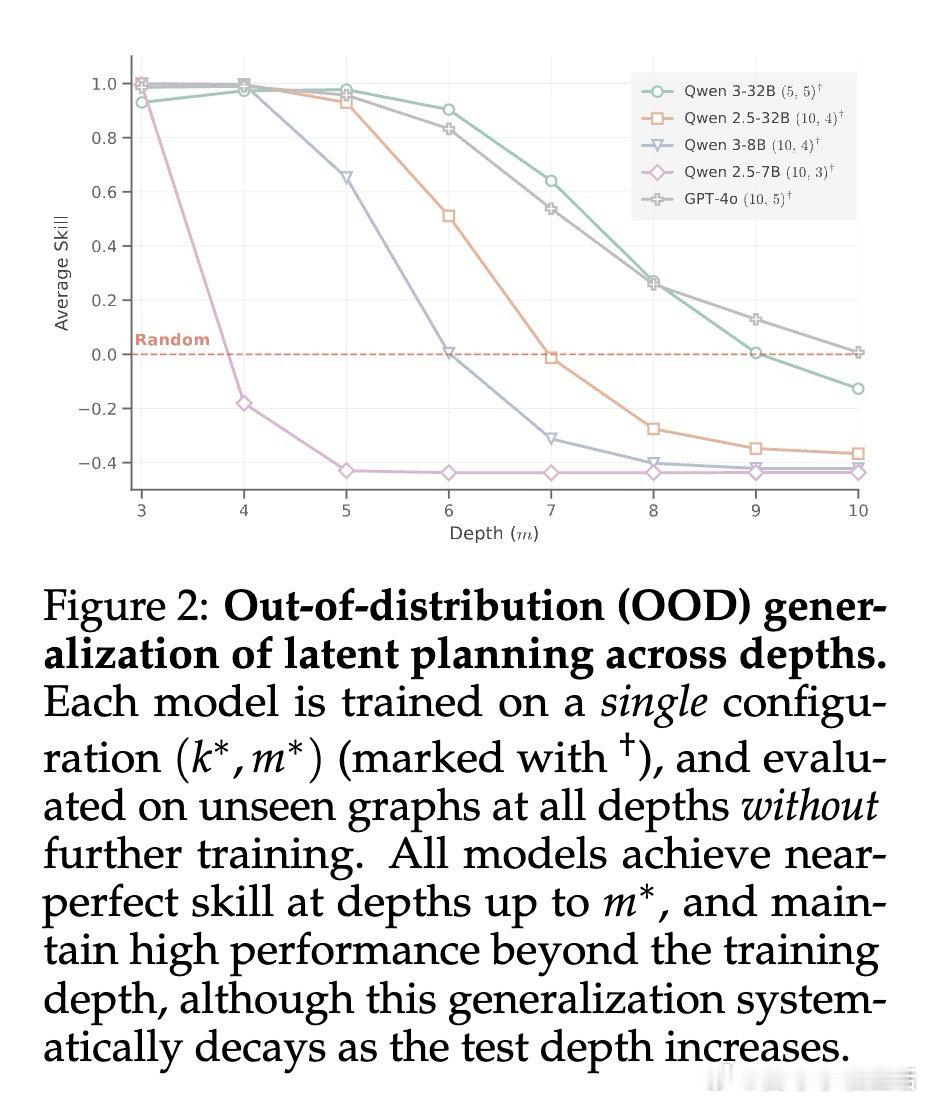

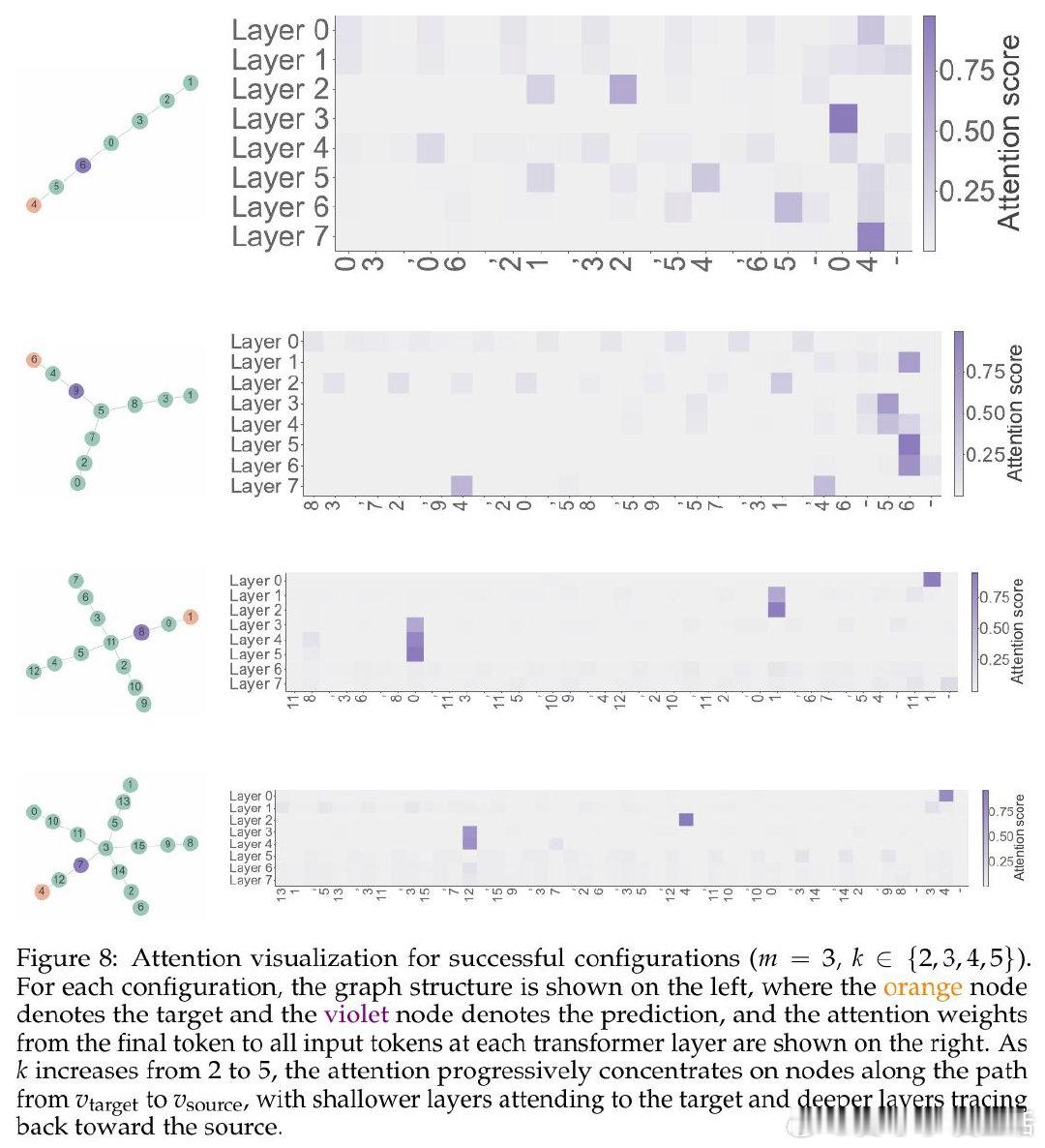

本文的核心洞见是:把"模型能否规划"拆解为两个独立能力——"能否发现策略"与"能否执行策略"。通过在对称星形图上精确控制所需潜在推理步数,研究者发现:从零训练的小型Transformer最多发现3步策略,微调后的前沿大模型(GPT-4o)止步于5步,GPT-5.4少样本提示下达7步——而这一天花板在模型规模从160万参数扩展至最强闭源模型的过程中,仅上移了约4步。更关键的是,训练于5步问题的模型可将策略泛化至8步,而直接训练于6至8步的模型始终随机猜测——发现能力与执行能力之间存在明确解耦。

这项工作真正留下的遗产是:首次以受控方式量化了梯度学习在稀疏监督下发现隐式多步策略的硬性上限,为CoT监控提供了实证支撑——当前模型确实无法将深层规划藏入潜在空间。它为后来者打开的新门是:如何利用监督信号粒度(稀疏→密集)系统性地调节这一上限,以及该天花板是否在定理证明、代码生成等领域同样存在。但尚未跨过的门槛是:研究者无法对最强前沿模型进行微调验证,且星形图的高度对称性意味着结论能否推广至含局部启发式线索的真实推理任务,仍是悬案。

arxiv.org/abs/2604.06427

机器学习 人工智能 论文 AI创造营